手把手教你本地部署DeepSeek-R1模型:两种可视化方法全攻略

分类:行业新闻 时间:2025-02-06 16:25:39 阅读:2851

想要在本地体验国产大模型DeepSeek-R1的强大能力?无需高配显卡,只需一台普通电脑,借助Ollama工具即可轻松部署!本文教你通过Docker+Open WebUI和Chatbox两种方式实现可视化操作,全程详细步骤+截图指引,从此告别“服务器繁忙”!

一、DeepSeek各模型配置与适用场景表

以下是不同规模DeepSeek模型的关键信息对比(以FP16精度推理为例),帮助您快速匹配需求: 1. 受众群体:根据模型规模划分典型用户类型,避免资源浪费。 2. 版本区别:重点功能差异(如代码生成、多语言、长文本优化等)。 3. 显存要求:若使用4-bit量化,显存需求可降低30%-50%(例如7B模型量化后仅需约8GB)。 4. 无显卡方案:1.5B/2B模型可通过Ollama的CPU模式运行(速度较慢)。

二、准备工作:安装Ollama并拉取DeepSeek-R1模型

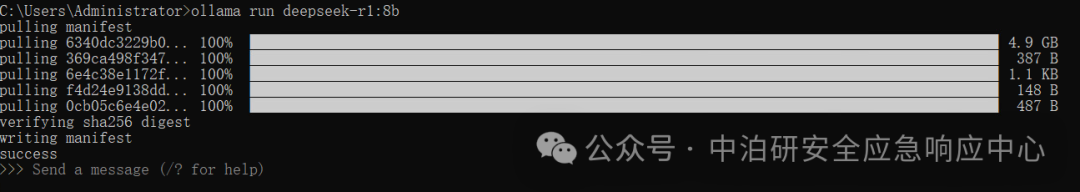

访问官网 https://ollama.com/,根据系统(Windows/Mac/Linux)下载安装包并安装,安装完成后打开终端输入命令验证是否安装成功:ollama run deepseek-r1:8b

等待下载完成后,模型会自动加载,显示“>>> Send a message...”即表示成功。

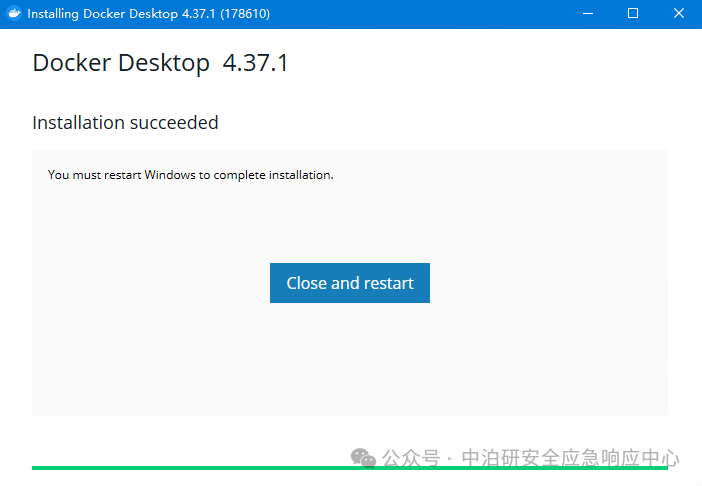

三、方法1:Docker部署Open WebUI可视化

- 访问 https://www.docker.com/

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

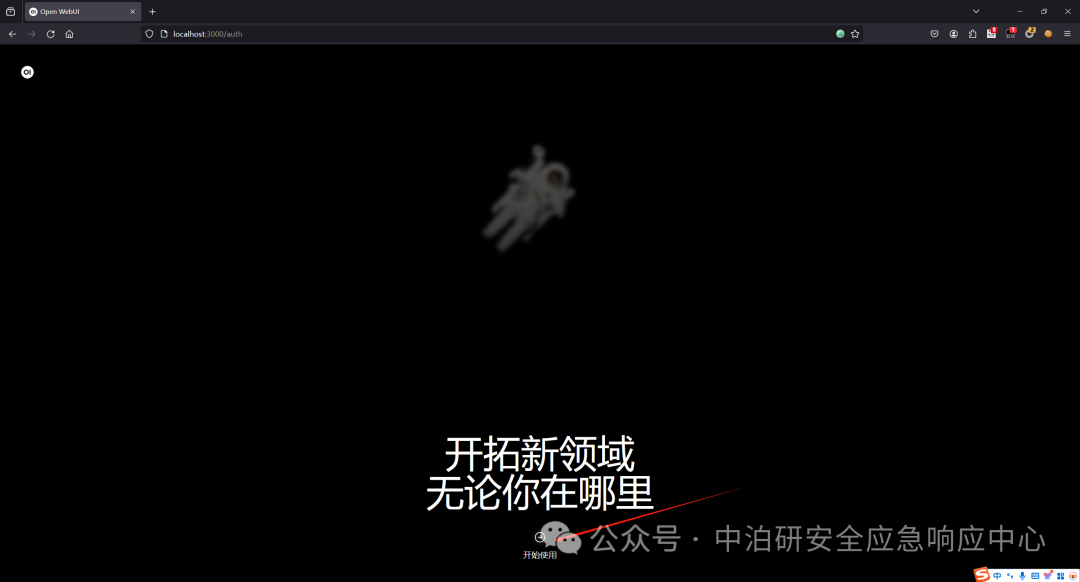

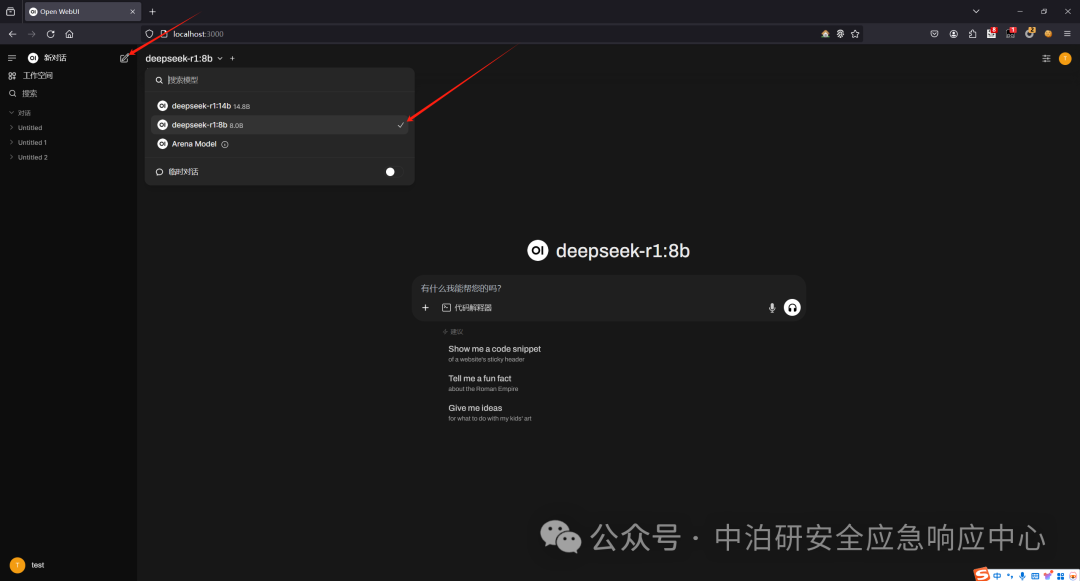

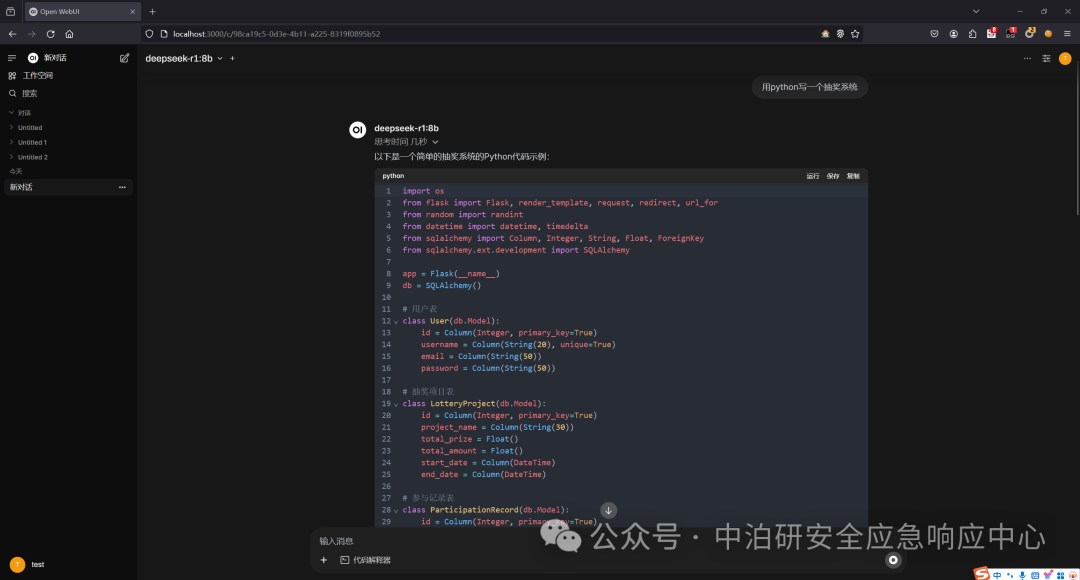

等待镜像拉取完成,浏览器访问 http://localhost:3000 进入Open WebUI。1. 首次登录:点击“开始使用”注册账号(任意邮箱+密码)。2. 绑定Ollama服务:点击新对话,选择已经部署好的本地模型3. 选择模型:选择“deepseek-r1:8b”即可开始对话!

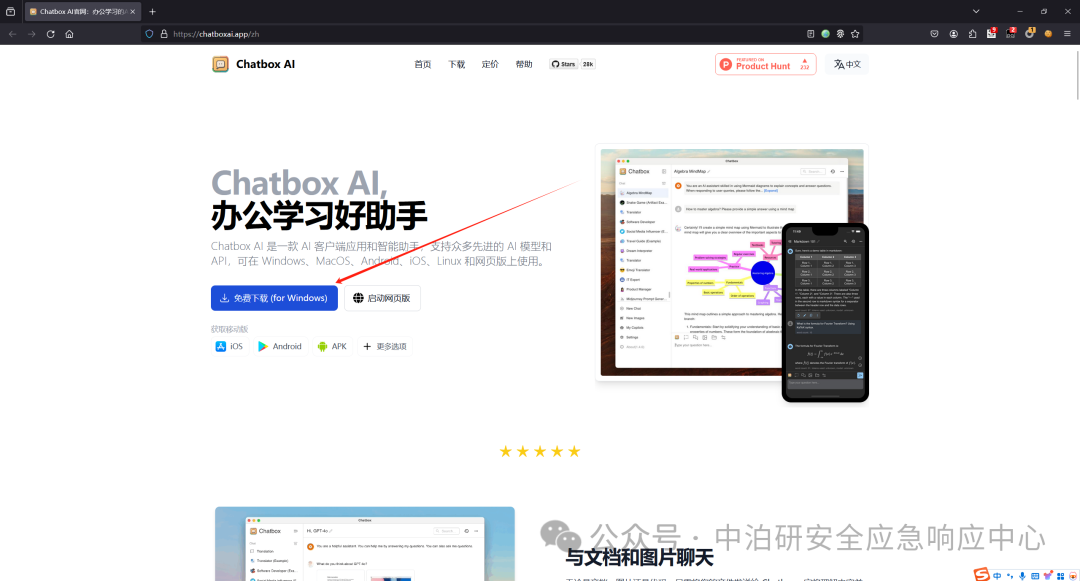

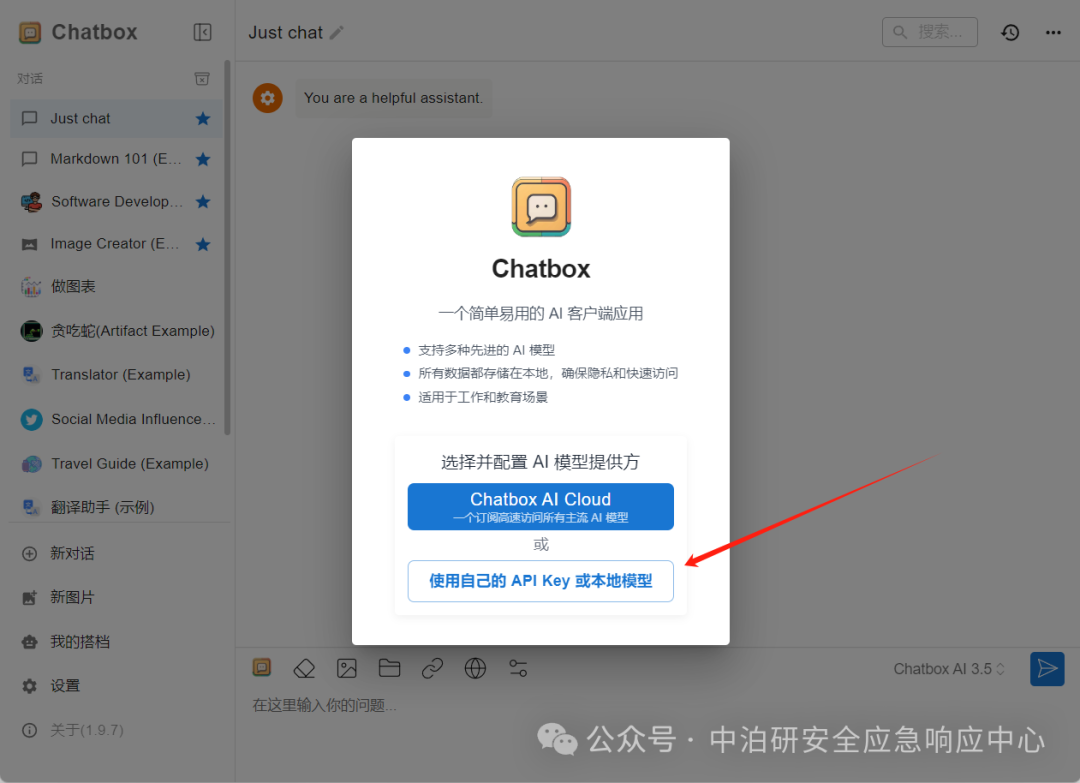

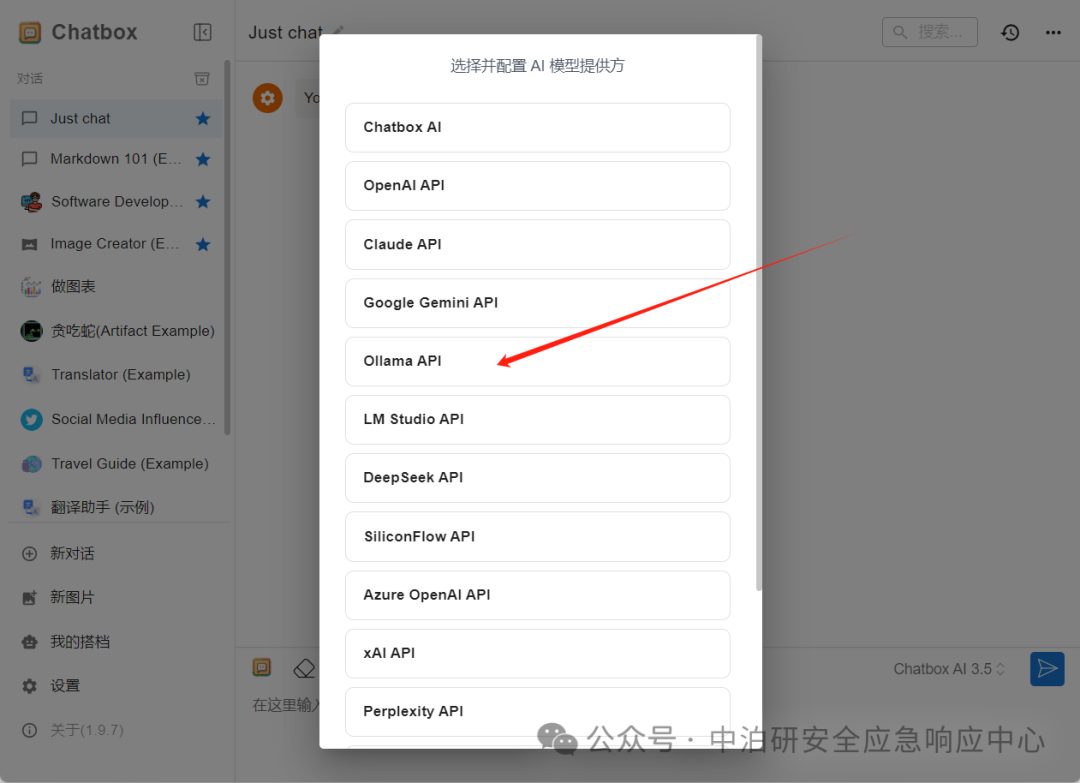

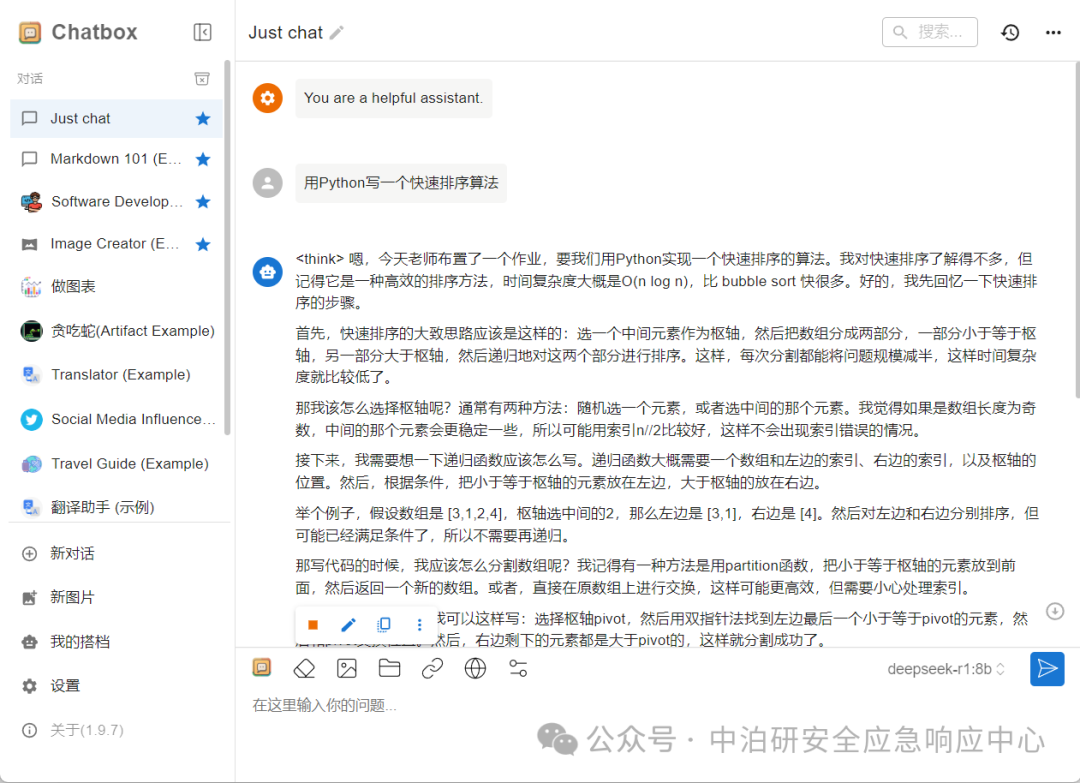

四、方法2:Chatbox客户端直连Ollama

- 访问 https://chatboxai.app/

返回聊天窗口,输入问题测试模型响应,如“用Python写一个快速排序算法”。

五、总结与常见问题

追求功能丰富选 Open WebUI,适合多模型管理;